今天,我们带来一个好消息,小宿科技模型托管服务已完成全面性能优化!服务升级后,长文本处理能力成为一大亮点。无论是长文本生成、代码补全,还是复杂推理任务,基于开源模型 DeepSeek 的托管服务现在能够提供更快的响应速度、更流畅的输出体验。那么,具体有哪些具体指标得到了提升,他们又有哪些实际用途,让我们一起来看看!

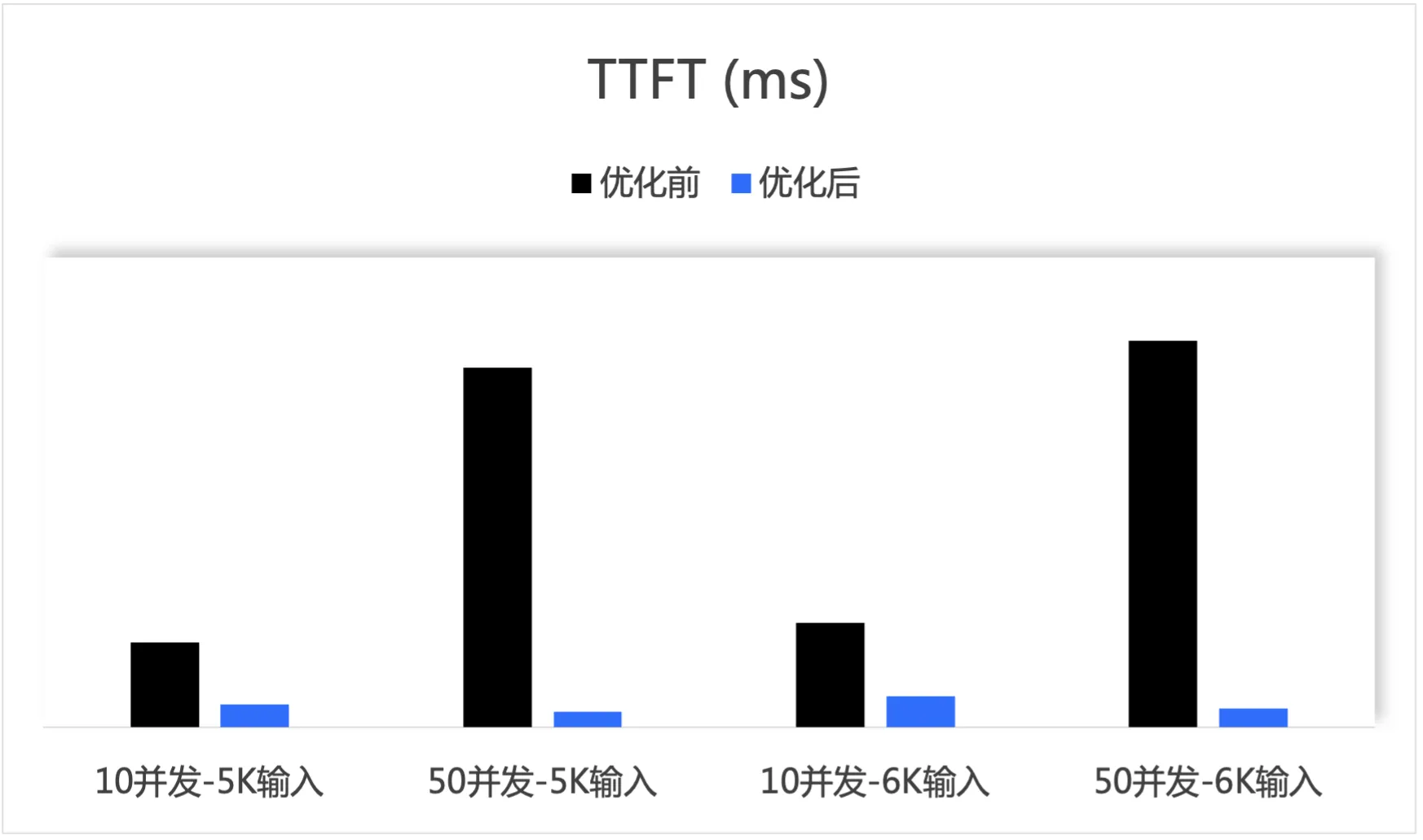

1. TTFT大幅降低 TTFT(Time to First Token) 是用户感知响应速度的关键指标,也是大语言模型性能评估的关键,特别是在流式输出场景(如AI对话)中尤为重要。本次优化后,DeepSeek在长文本任务中的首Token生成速度平均提升10倍以上,让AI对话无限接近“即时响应”!

典型场景:

• 聊天机器人首条回复更快,告别“等待焦虑”

• 代码补全、文章续写,首Token“秒出”

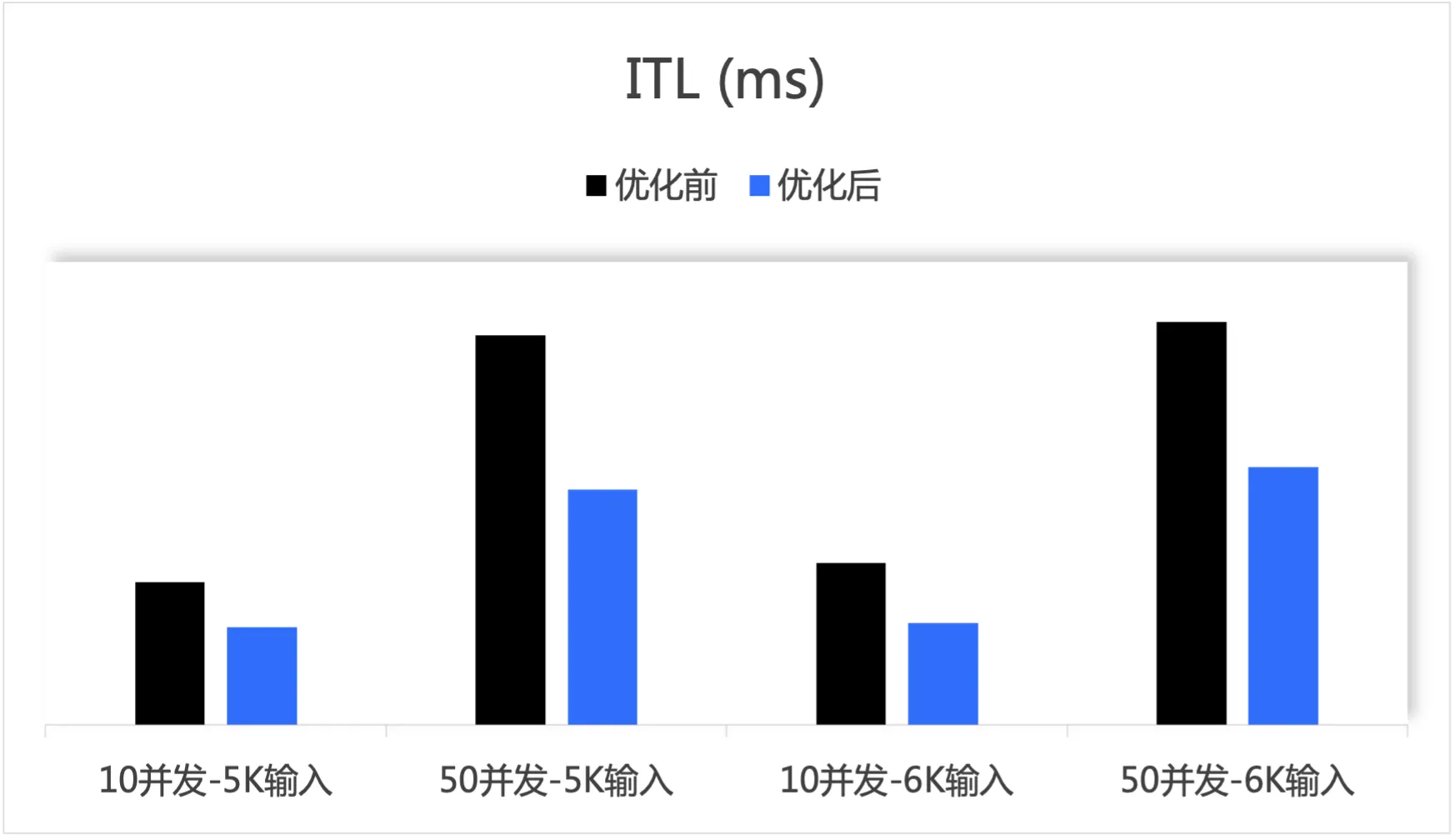

2. ITL更稳定,输出更流畅ITL(Inter-Token Latency) ,指的是生成每个 Token 之间的实际间隔时间,决定了模型在持续输出时的流畅度。性能升级后,DeepSeek在长文本生成时,Token间延迟波动更小,平均token间掩饰降低了 40%+,有效避免了“卡顿式输出“。

典型场景:

• 实时对话与客服机器人,提供更自然的对话体验

• 大段代码生成,报告撰写,更加连贯,不再“断断续续”

• 会议实时转录与总结,可实现更流畅的实时会议纪要生成

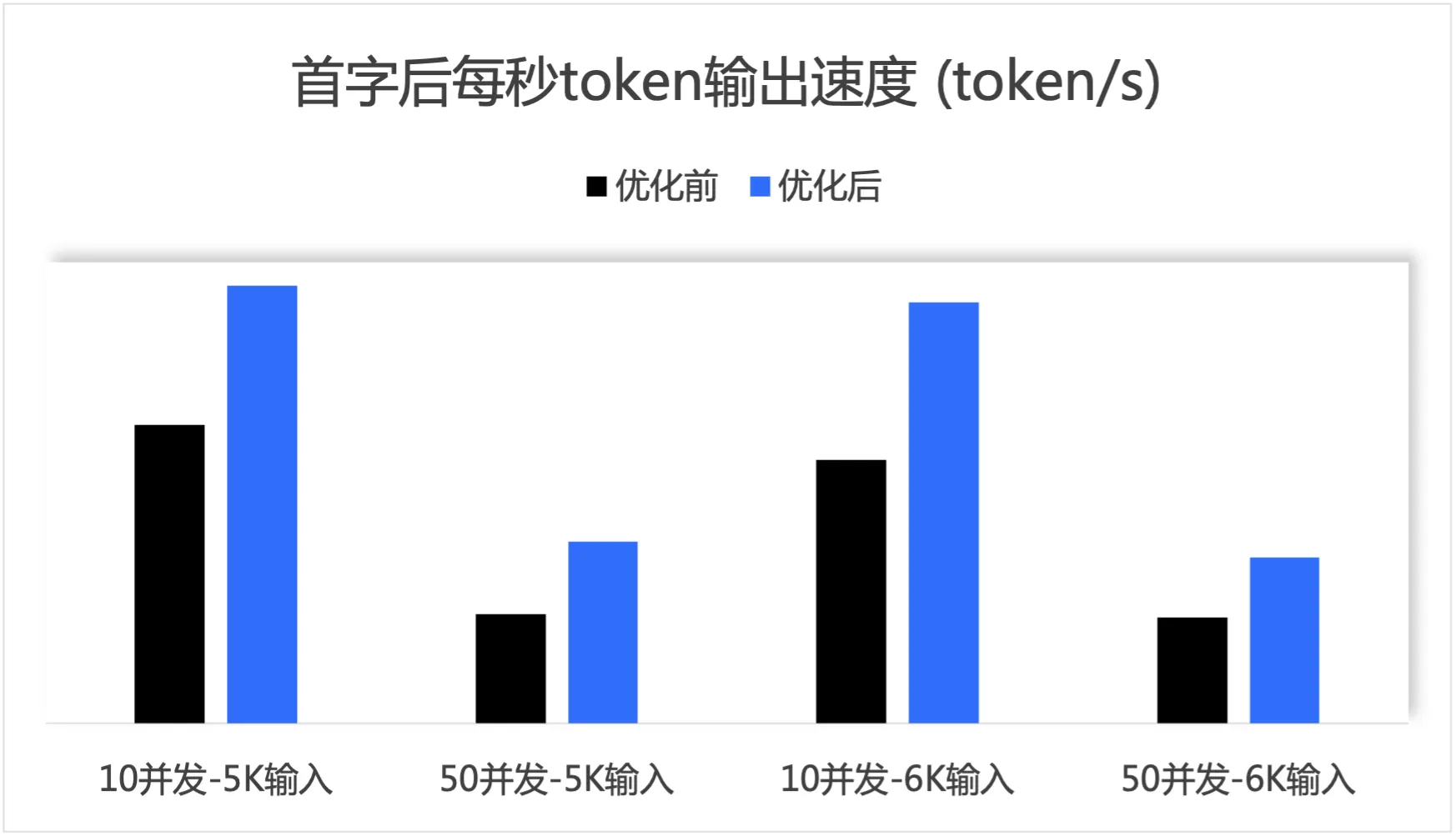

3. 每秒Token输出速度(TPS)飙升本次升级还优化了Token生成吞吐量(Tokens Per Second, TPS),让模型在单位时间内输出更多内容,输出速度提升超过50%,这意味着同样时间内,AI能生成更多内容,生成超长文本生成耗时大幅减少。

典型场景:

• 批量生成营销文案、产品描述,速度更快

• 自动化报告撰写,节省大量时间

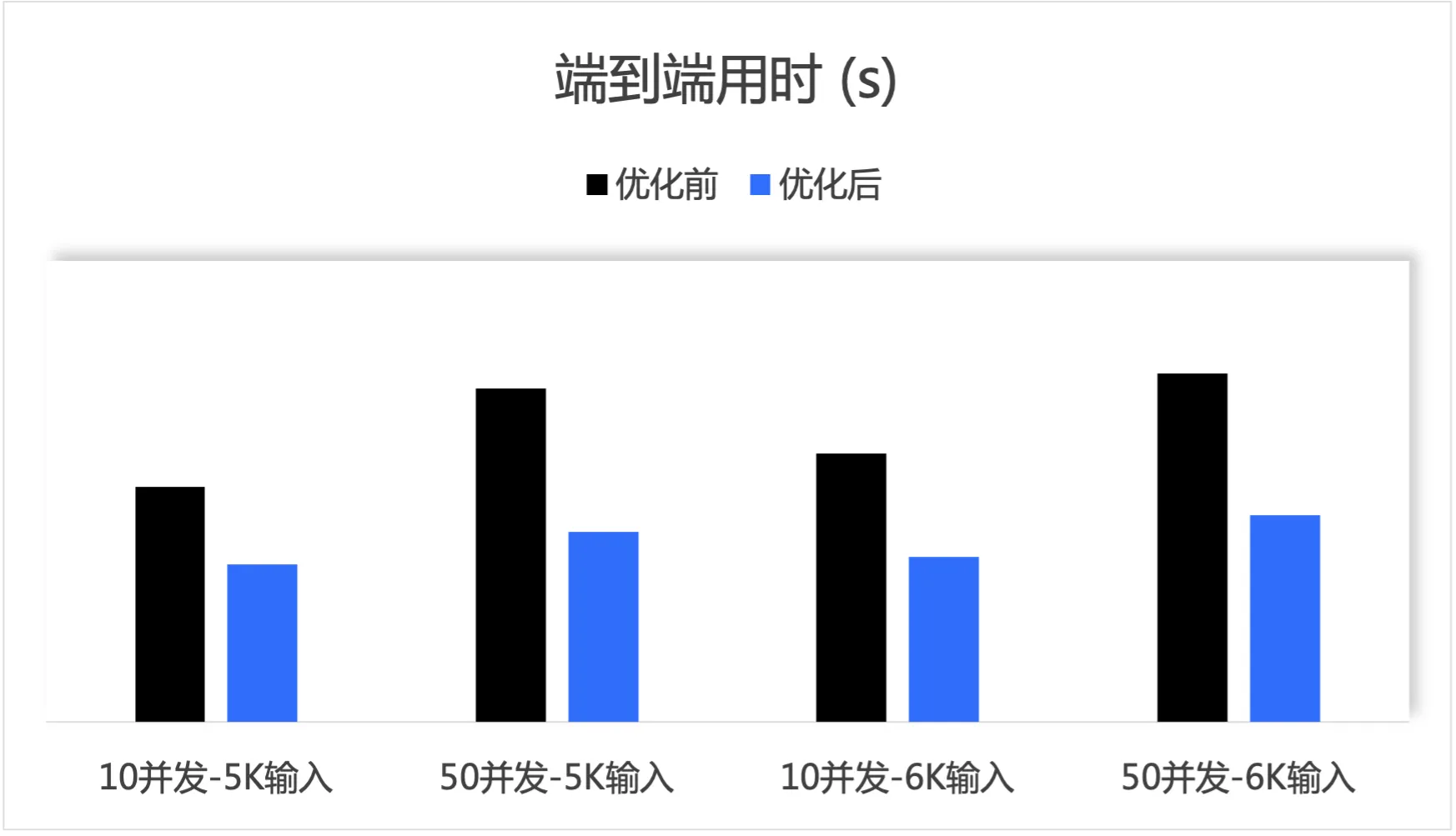

4. 端到端用时显著缩短端到端用时(End-to-End Latency) 是用户从发送请求到获取完整结果的总时间,是衡量AI系统整体性能的黄金指标,覆盖了从用户发起请求到获取完整输出的全链路延迟。它包括了TTFT、ITL、网络传输时间及后处理时间等多个组成部分。本次性能优化后,DeepSeek 在超 5000 token 的超长文本任务中,整体响应速度提升 40%+,超长文本生成效率跃升。

典型场景:

• 法律合同、技术文档生成效率革命,耗时减少近半

• 数据分析报告输出,效率翻倍

模型托管核心优势

· 行业领先的推理优化技术——更低延迟、更高稳定性

· 超长上下文支持——轻松处理数千Token长文本

· 极致性价比——高性能,低成本

· 低延迟、高流畅度—— TTFT、ITL优化,响应更快,输出更稳定

使用微信扫描二维码分享给好友或朋友圈